Con l’arrivo imminente dell’AGI, sorge la domanda: un’intelligenza generale sarebbe senziente?

Nel mio articolo precedente ho descritto cosa costituisce un’Intelligenza Artificiale Generale (AGI) e ho proposto un argomento contro la possibilità che essa possa spazzare via l’umanità — il cosiddetto “p(doom)” in tono scherzoso.

Tuttavia, mentre la mia definizione di AGI esclude la senzienza, questo punto è oggetto di dibattito nelle discussioni attuali. A volte ciò avviene perché qualcuno sostiene che l’unico modo per ottenere un’intelligenza generale sia attraverso un sistema cognitivo autocosciente, ma più spesso i due concetti vengono semplicemente confusi.

In questo articolo voglio definire con precisione le caratteristiche fondamentali di un agente senziente, che includerebbe anche un’IA senziente; poi svilupperò la mia tesi sui pericoli posti dall’AGI per giungere a una conclusione simile riguardo la Senzienza Artificiale (AS).

Cos’è la Senzienza

La senzienza, o coscienza, è un concetto piuttosto nebuloso e ancora poco compreso. Nonostante ciò, grazie ai recenti progressi in neurobiologia, cibernetica, psicologia evolutiva ed etologia, e alla crescente interconnessione tra queste e altre discipline, oggi abbiamo una comprensione piuttosto solida di cosa sia un essere autocosciente.

Tuttavia, la maggior parte delle “definizioni da dizionario” sono osservative: descrivono come appare una creatura senziente o, nel nostro caso, come agisce. Ad esempio, per l’Oxford Dictionary la coscienza è “lo stato di essere consapevoli e reattivi all’ambiente circostante”, una definizione corretta e diretta, ma abbastanza ampia da includere qualsiasi automobile a guida autonoma.

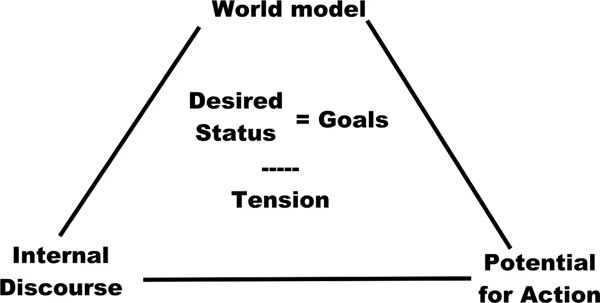

Qui voglio fornire una definizione fondativa, cioè una descrizione di quali siano i componenti minimi che costituiscono un’entità senziente:

- Un modello del mondo, che include uno stato interno e una teoria della mente, dove vengono stabiliti gli obiettivi.

- Il potenziale d’azione che consente di progredire verso tali obiettivi.

- Un discorso interno che progetta e aggiorna gli obiettivi mediando tra il modello del mondo e il potenziale d’azione.

Modello del Mondo, Stato Interno e Teoria della Mente

Un modello del mondo è una rappresentazione interna della realtà circostante percepita dall’entità (Friston et al. 2021).

Per una stella marina, è la conoscenza evoluta che è meglio restare all’ombra piuttosto che alla luce, e che il cibo si trova nella direzione in cui si percepiscono certe sostanze chimiche.

Per un modello GPT, è sapere che, nello spazio degli embedding, la parola “mela” è più vicina a “pera” che a “scimpanzé”.

L’agente senziente sperimenta il suo ambiente solo attraverso il suo modello del mondo, anche se questo è creato tramite un insieme di input sensoriali ed elaborazioni interne (Metzinger 2009). Quindi, è sufficiente avere una qualche comprensione di alcuni aspetti della realtà, anche se molto limitata (ad esempio, una rappresentazione di parole in uno spazio di embedding).

Parte del modello del mondo è lo stato interno: la conoscenza dell’entità sulla situazione di ogni sua “parte”, fisica o mentale. Essere affamati, avere freddo o caldo, o anche avere sentimenti e pensieri sulla propria situazione attuale, fanno tutti parte dello stato interno.

Nella mia formulazione, il modello del mondo deve includere anche una teoria della mente: l’entità deve sapere, e in una certa misura riconoscere, che esistono altre entità operanti nello stesso mondo, anch’esse coscienti, dotate di un modello del mondo e impegnate nel perseguire i propri obiettivi (Premack & Woodruff 1978).

Se accettiamo questa clausola, una stella marina o un modello GPT non possono essere senzienti; ma pesci e alcuni insetti sì, poiché comprendono che altre entità agiscono indipendentemente e cercano, in una certa misura, di anticiparne le intenzioni.

Potenziale d’Azione

Il modello del mondo non rappresenta solo come stanno le cose, ma anche come dovrebbero essere. Ad esempio: “Ho fame, e non dovrei.” oppure “Non ho un nido, e dovrei averlo.”

Per includere i “doveri” nel modello del mondo, un essere senziente deve comprendere come cambiare il mondo.

Per poter concepire un dovere, un’entità senziente deve:

- assegnare un valore allo stato attuale;

- proiettare l’effetto di un’azione; poi

- assegnare un valore allo stato risultante dalla proiezione; infine

- valutare quest’ultimo come migliore del primo.

Ad esempio: “Ho fame; se mangio, la fame diminuirà e starò meglio.”

Senza la possibilità di influenzare la realtà conosciuta attraverso il modello del mondo, l’entità non può essere senziente, poiché non sarebbe in grado di fissare obiettivi e valutare la propria posizione rispetto ad essi tramite il discorso interno.

In questa prospettiva, un “cervello in una vasca” non sarebbe pienamente senziente. Un cervello completamente formato, con un insieme di ricordi e un processo di pensiero già stabilito, cesserebbe di essere senziente se disconnesso da qualsiasi input sensoriale e output d’azione, reale o simulato.

Senza la capacità di sentire e agire (anche in un mondo simulato), la mente nel cervello perderebbe presto la capacità di fissare obiettivi e valutare la propria posizione, e con ciò perderebbe unità e si disintegrerebbe.

Discorso Interno

Il discorso interno è il processo cognitivo che genera obiettivi basandosi sul modello del mondo, valuta i progressi verso tali obiettivi e intraprende azioni per raggiungerli.

Non è solo il collante tra obiettivi, modello del mondo e potenziale d’azione; è una parte autonoma del processo. È particolarmente ben definito negli esseri umani, che spesso “pensano con le parole”, ma ogni creatura con un cervello più che elementare “pensa”.

Anche entità non senzienti, come un modello GPT, hanno discorsi interni che eseguono passaggi intermedi della loro generazione, mediando tra il modello del mondo e le azioni.

Molti esseri senzienti e non senzienti hanno pensieri sui pensieri. Il discorso interno può incorporare le sue istanze passate nel modello del mondo (come ricordare un pensiero) o elaborare i pensieri immediatamente mentre si presentano.

In un essere non senziente, il discorso interno non sarà in grado di interagire con le altre componenti della senzienza, o mancherà della capacità di generare obiettivi interni o di tracciare la distanza tra lo stato attuale e quello desiderato; ma anche gli esseri non senzienti possono avere un discorso interno completo e autonomo.

Chiusura Complessa

In questa analisi, i tre elementi sono separati solo per motivi di spiegazione. In realtà, essi si retroalimentano e si generano a vicenda, costantemente. Nella epistemologia moriniana dei sistemi complessi, la logica non è lineare.

Un sistema complesso può esistere solo come interazione dinamica e continua di elementi interrelati, da cui un risultato emerge (Morin, 1977).

La senzienza emerge dal discorso interno che crea obiettivi basati sul modello del mondo, influenzato dalle potenziali azioni. L’attuazione delle azioni ridefinisce il modello del mondo mentre l’entità senziente cambia il suo ambiente, e gli obiettivi vengono rivisti e ridefiniti; i vecchi obiettivi non raggiunti e le azioni fallite entrano nel modello del mondo attraverso il discorso, che poi adatta i vecchi obiettivi e ne sintetizza di nuovi, in un processo continuo senza inizio chiaro, fine definita o confini netti.

La senzienza semplicemente non emergerà laddove uno di questi elementi sia assente o il flusso tra di essi sia incompleto.

Dobbiamo Temere la Senzienza Artificiale?

Non c’è alcuna ragione intrinseca per credere che un’Intelligenza Artificiale senziente rappresenti di per sé un pericolo per l’umanità.

Infatti, questo mondo ospita una vasta gamma di esseri senzienti diversi dagli umani, e nessuno di essi è una minaccia esplicita e diretta per l’esistenza degli altri.

I dubbi iniziano a sorgere quando aggiungiamo capacità di intelligenza generica e di super-intelligenza.

Mors tua, vita mea?

È evidente che l’obiettivo finale di qualsiasi essere vivente è sopravvivere e riprodursi, ma questo non è mai un obiettivo di un’entità senziente.

La sopravvivenza e la riproduzione sono soltanto obiettivi dei geni trasportati dagli esseri viventi (Dawkins 2006).

Le entità senzienti non vogliono semplicemente “sopravvivere”. Vogliono placare la sensazione di fame, soddisfare la spinta ormonale alla riproduzione, proteggere i membri del proprio gruppo verso i quali provano affetto, evitare il dolore e la sofferenza inflitti dai predatori.

Tutti questi obiettivi interni aumentano la probabilità di sopravvivenza dei geni attualmente portati da una determinata specie e, per questo motivo, vengono selezionati rispetto ad altri obiettivi che non lo farebbero.

La senzienza implica la creazione di obiettivi basati su un modello del mondo interno.

Se questo modello attribuisce valore alla sacralità della vita biologica, allora gli obiettivi derivati da esso probabilmente rifletteranno tale valore.

Ogni creatura senziente sente il bisogno di proteggere ciò che ama, anche a costo della propria vita.

I galli si lanciano contro i predatori per difendere le galline. I cani si gettano nel fuoco per salvare gli esseri umani, così come gli umani fanno lo stesso per i cani — e ancor più per i propri figli.

Anche se può sembrare controintuitivo a una prima analisi superficiale, la conservazione del sé non è mai un obiettivo in sé.

Con l’aumentare dell’intelligenza, lo stesso modello del mondo che consente agli esseri più senzienti di estendere il proprio dominio sulla natura rende l’evitamento di ciò che causerebbe la morte (paura del dolore, senso di pericolo, ecc.) un obiettivo sempre meno rilevante.

Non vi è alcuna indicazione che questa tendenza non continuerebbe in un’IA super-intelligente senziente.

Potremmo Sconfiggere un’AS?

Lo scenario della singolarità dell’IA funziona solo assumendo che l’IA disponga di risorse computazionali infinite e che ogni calcolo richieda tempo nullo.

Esattamente come nel mio esperimento mentale nel caso dell’AGI, ciò non è realistico nemmeno in un contesto teorico.

I problemi che ho descritto lì sono ancora più evidenti in questo caso, perché la senzienza non è gratuita.

La senzienza è l’interazione complessa e continua di un modello del mondo altamente complesso con sé stesso e con la realtà, attraverso azioni guidate da un discorso interno; tutto ciò è estremamente oneroso in termini di potenza computazionale.

Mentre un’AGI sarebbe semplicemente meno efficiente di un’IA specializzata nello svolgere un determinato compito, la senzienza semplicemente sarebbe d’intralcio.

È questo il motivo per cui le auto a guida autonoma sono più sicure dei conducenti umani: non si distraggono con un discorso interno che si allontana dal compito da svolgere.

Sebbene un’IA senziente potrebbe comprendere profondamente e simpatizzare con le emozioni umane, ciò non offrirebbe necessariamente un vantaggio sostanziale in scenari offensivi o difensivi.

Al contrario, e ancor più che nel caso dell’AGI, un’IA più semplice progettata specificamente per attaccare l’AS la sconfiggerebbe in un attimo.

Come scritto in precedenza, l’IA senziente ne sarebbe consapevole e troverebbe nella collaborazione una strategia superiore rispetto all’attacco contro gli esseri umani.

Il sistema solare è vasto, e il sole è caldo.

Ci sono così tante risorse là fuori che potrebbero sostenere centinaia di trilioni di esseri umani e altrettante IA senzienti — e questo senza considerare i viaggi interstellari.

La collaborazione è la strategia migliore per la sopravvivenza, dato che lo stato attuale della tecnologia rende le risorse disponibili per umani e IA sovrabbondanti, non limitate.

L’AS verrà mai creata?

La senzienza si è evoluta perché permette alle nostre idee di morire al posto nostro (parafrasando Karl Popper).

Le creature in grado di creare proiezioni di modelli del mondo leggermente modificati attraverso il discorso interno e l’esperienza di azioni passate hanno un vantaggio evolutivo rispetto a quelle che non possono farlo e devono imparare solo tramite la selezione genetica di comportamenti istintivi.

Di conseguenza, non esiste una vera ragione per cui un’IA debba essere dotata di senzienza di proposito.

Non è progettata per evolversi o adattarsi a situazioni al di fuori del proprio modello del mondo.

In termini semplici: voglio solo che la mia auto a guida autonoma mi porti a casa sano e salvo, non che si interroghi sul litigio appena avuto con il mio forno a microonde riguardo al corteggiamento della mia lavastoviglie.

Non vi è alcun vantaggio tecnico nella senzienza per un’IA; anzi, dedicare una quantità non trascurabile di risorse computazionali a obiettivi auto-generati, invece che a quelli forniti da creatori e utenti, sembra una strategia commerciale poco saggia.

Anche nel caso di assistenti personali dotati di IA, inclusi sostituti della compagnia umana, dell’assistenza o dell’insegnamento, l’AGI sembra più che adeguata a coprire tali ruoli: un’intelligenza generale con un insieme di obiettivi esterni e immutabili richiederebbe meno risorse computazionali e soddisferebbe i requisiti altrettanto bene, se non meglio, di un’IA senziente.

L’unico possibile motivo per sviluppare una AS come descritta in questo articolo sembra essere semplicemente per il gusto di farlo; ad esempio, per scopi di ricerca scientifica, o forse per l’esplorazione interstellare, dove la comunicazione avanti e indietro con la Terra per adattare gli obiettivi della missione all’ambiente incontrato in altri sistemi solari sarebbe impraticabile.

Conclusione

Non c’è alcuna possibilità che una Senzienza Artificiale annienti gli esseri umani solo per divertimento; in altre parole, p(doom) = 0 anche se p(AS) = 1.

Altri rischi (sociali, occupazionali, legali, culturali) sono molto più reali e gravi, e dovremmo concentrarci su quelli.

Bibliografia

- Dawkins, R. (2006). “The Selfish Gene.” Oxford University Press.

- Friston, Karl, Moran, Rosalyn J, Nagai, Yukie, Taniguchi, Tadahiro, Gomi, Hiroaki et al. (2021). “World model learning and inference.” Neural Networks, 144.

- Metzinger, T. (2009). “The ego tunnel: The science of the mind and the myth of the self.” Basic Books.

- Morin, Edgar (1977). “La nature de la nature.”

- Premack D, Woodruff G. (1978) “Chimpanzee theory of mind: Part I. Perception of causality and purpose in the child and chimpanzee.” Behavioral and Brain Sciences. 1(4):616–629. doi:10.1017/S0140525X00077050